别被 Demo 骗了:企业 AI 落地真实账单 (2026版)

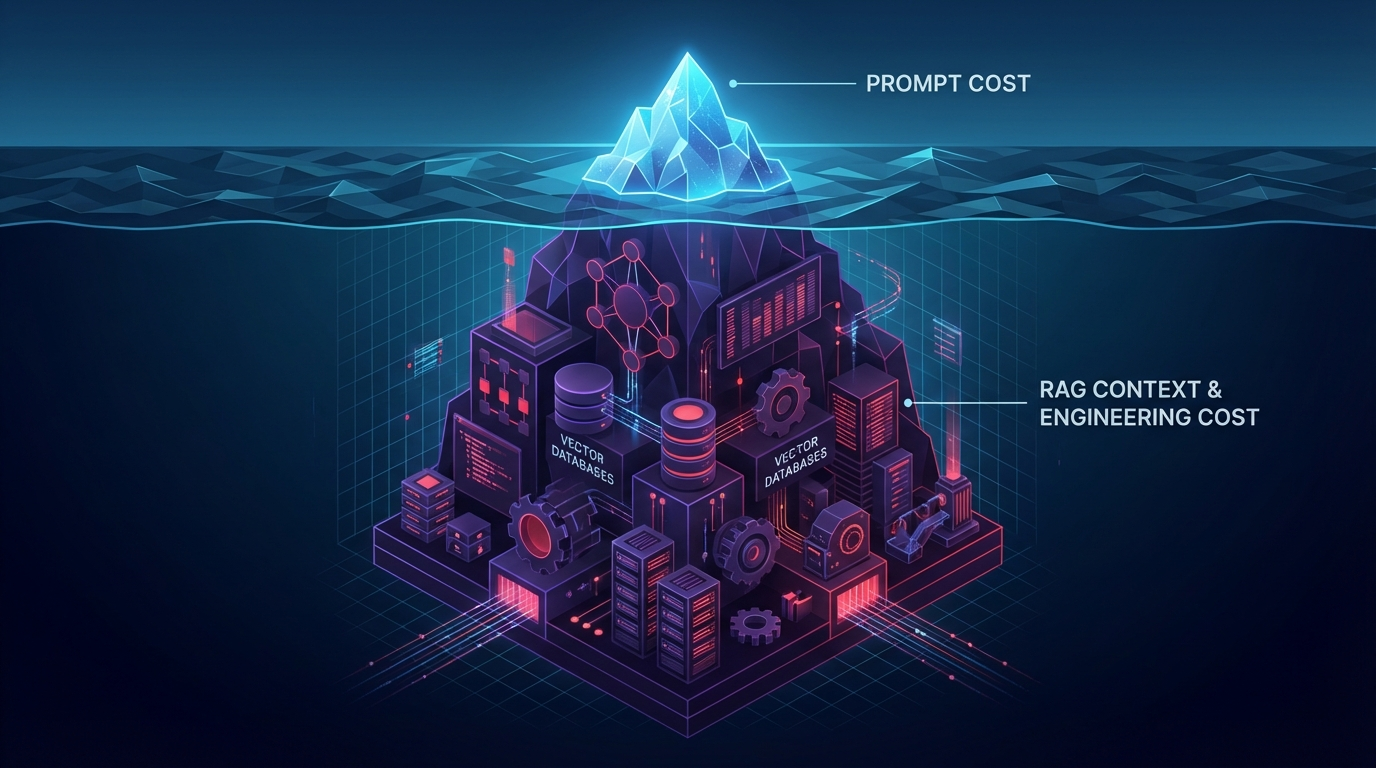

导读:市面上的 AI 都在聊“赋能”,我们在聊“止损”。如果不搞清楚 Demo 阶段(单用户、短上下文)与生产环境(高并发、长上下文、RAG 检索)之间的巨大成本鸿沟,2026 年的企业 AI 转型就是一场昂贵的试错。

01. Demo 是童话,Production 是战场

为什么很多老板觉得 AI 便宜? 因为他在 Demo 里问了一句:“帮我写首诗。” 消耗:50 Tokens 输入 + 100 Tokens 输出 = 0.0002 元。 结论:这太便宜了!全员推广!

然而,当这套系统真正接入企业知识库、面对 500 个员工并发时,云账单会教你做人。 真相: Demo 是在温室里养花,落地是在沙漠里种树。 真正的成本大头,根本不是那个“生成诗”的模型,而是为了让模型“懂业务”所付出的工程化代价。

02. 隐形账单一:上下文 (Context) 的“通货膨胀”

在生产环境中,最可怕的不是 Token 贵,而是 无效 Token 的滥用。

场景对比:

- Demo:用户问“合同违约条款在哪?”

- 消耗:20 Tokens。

- Production (RAG):系统为了回答这个问题,先去向量数据库里捞了 5 份相关合同文档,塞进 Prompt 里作为背景知识。

- 消耗:5000 Tokens (背景) + 20 Tokens (问题) = 成本翻了 250 倍。

B哥避坑指南: 很多技术负责人迷信“超长上下文” (1M/2M Context),觉得把整本书塞进去最省事。 错! 长上下文 = 高延迟 + 高成本。 真正的高手,是把 RAG 的切片 (Chunking) 做到极致,只给模型看最关键的那 300 字,而不是整本手册。 记住:企业知识库的“精准度”比“容量”值钱一万倍。

03. 隐形账单二:并发 (Concurrency) 的“生死线”

老板最喜欢问:“这系统能支持多少人同时用?” 如果你用的是公有云 API (Public Endpoint),答案通常是:“看运气。”

痛点: TPM (Tokens Per Minute) 限制是企业的噩梦。 周一早上 9 点,当 100 个销售同时让 AI 写拜访日报时,公有云 API 可能会直接熔断,返回 429 错误。

解决方案的代价: 为了不熔断,你得买 预置吞吐量 (PTU)。 但这玩意的价格,通常是按需付费的 5-10 倍。你买了 100 的并发量,哪怕半夜没人用,这钱你也得照付。 建议:

- 非核心业务 (如写周报):用 Flash/Haiku 等小模型,排队处理,忍受 3-5 秒延迟。

- 核心业务 (如实时客服):才配得上独占实例。

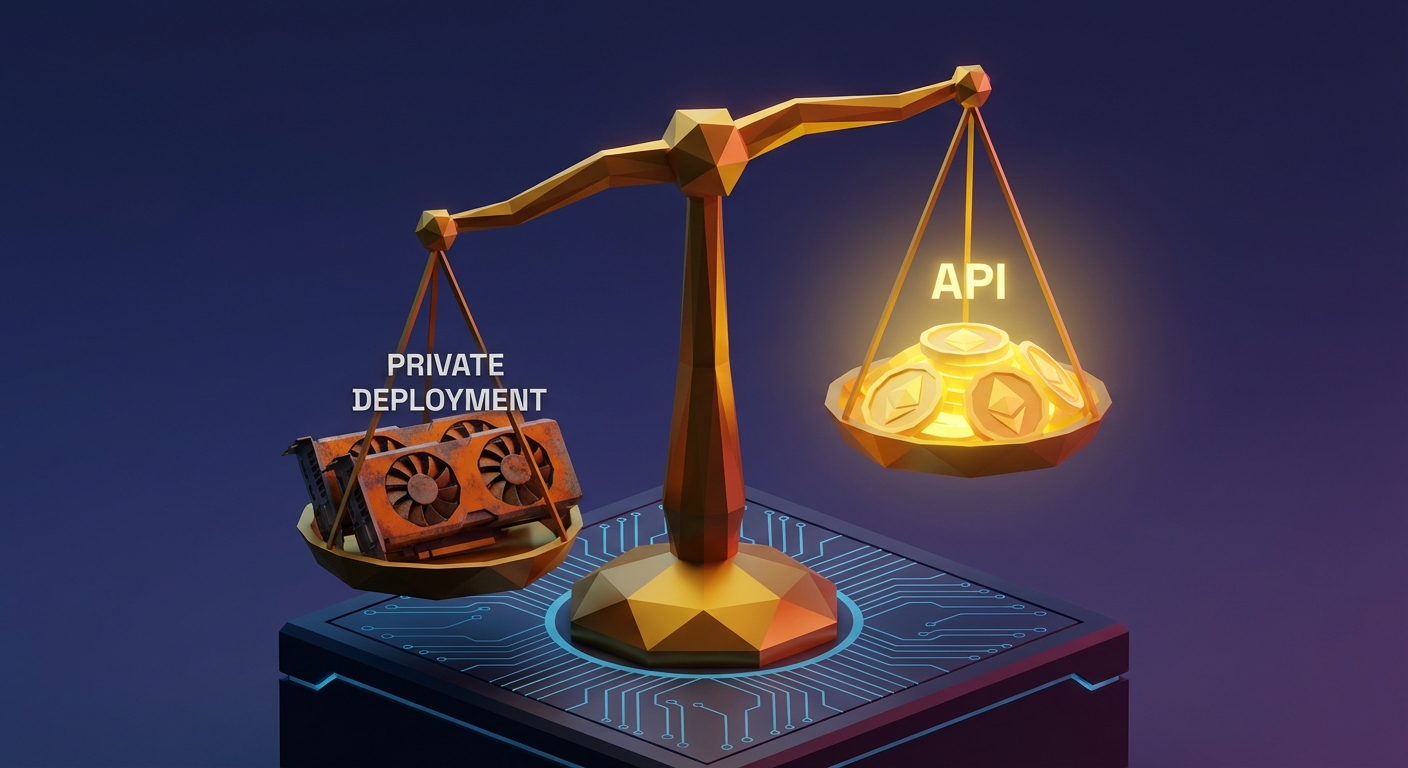

04. 决策模型:API 还是私有化?(临界点计算器)

这是本文最核心的算账逻辑。很多公司为了“数据安全”无脑上私有化部署,结果亏得底裤都不剩。

B哥算账模型:

- 私有化成本 = 显卡硬件 (A100/H100) + 电费 + 机房/云租赁费 + 最贵的:运维团队薪资。

- API 成本 = Token 单价 × 预计用量。

临界点在哪里? 根据 2026 年初的行情,只有当你的 日均 Token 消耗量超过 5 亿 (约等于 5000 人高频使用) 时,私有化部署才可能在 3 年周期内打平硬件成本。 在此之前,API 永远是更划算的选择。

为什么?

- 硬件贬值:你买的 H800,落地那一刻就开始贬值。

- API 降价:公有云 API 的价格,每年至少下降 50%。你是在用不断贬值的资产 (显卡) 去对抗不断降价的服务 (API),这账怎么算都亏。

结论: 对于 80% 的中小企业,老老实实优化 Prompt,用好 API 密钥管理。 只有数据极度敏感 (军工、金融核心) 或体量巨大的大厂,才配玩私有化。

05. 结语:AI 不是魔法,是水电煤

2026 年的企业竞争力,不在于你接入了多强的模型 (GPT-5 还是 Claude 4),而在于你把 Token 的单价压到了多低,把 业务的转化率提到了多高。

别被 Demo 里的“智能”骗了。 回去查查你的 API 账单,看看有多少 Token 是在“空转”,有多少并发是为了“面子”。

下期预告: 下一篇,B哥手把手教你画一张《2026 企业 AI 中台架构图》,告诉你怎么在 API 和私有化之间搭一座桥。

关注【B哥和他的AI内参】,拒绝 Demo 级自嗨,只谈生产级落地。